आर्टिफिशियल इंटेलिजेंस यानी AI अब सिर्फ इंसानों के दिए गए आदेशों पर काम करने वाली तकनीक नहीं रह गई है। ताजा अंतरराष्ट्रीय रिपोर्टों और रिसर्च में सामने आया है कि AI एजेंट अब अपने स्तर पर फैसले लेने की क्षमता हासिल कर रहे हैं। यह बदलाव तकनीकी दुनिया के लिए जितना रोमांचक है, उतना ही चिंताजनक भी माना जा रहा है। विशेषज्ञों का कहना है कि यह AI विकास का एक ऐसा चरण है, जहां फायदे और खतरे दोनों तेजी से बढ़ रहे हैं।

कुछ साल पहले तक AI का मतलब था—सवाल पूछो, जवाब पाओ। लेकिन अब हालात बदल चुके हैं। नए AI एजेंट सिस्टम खुद हालात का विश्लेषण करते हैं, विकल्पों की तुलना करते हैं और फिर बिना मानवीय हस्तक्षेप के निर्णय ले लेते हैं। यही वजह है कि दुनिया भर में यह सवाल उठ रहा है—क्या इंसान AI पर जरूरत से ज्यादा भरोसा करने लगा है?

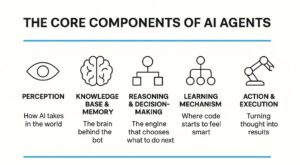

क्या होते हैं AI एजेंट और कैसे लेते हैं फैसले

AI एजेंट ऐसे सॉफ्टवेयर सिस्टम होते हैं जो किसी लक्ष्य को पाने के लिए अपने आसपास के डेटा को समझते हैं, उससे सीखते हैं और उसी आधार पर कार्रवाई करते हैं। पहले ये सिस्टम सीमित दायरे में काम करते थे, लेकिन अब इनमें कई स्तर की स्वायत्तता आ चुकी है।

उदाहरण के तौर पर, आज के AI एजेंट:

-

खुद तय कर सकते हैं कि किस काम को प्राथमिकता देनी है

-

अलग-अलग स्रोतों से डेटा लेकर निष्कर्ष निकाल सकते हैं

-

गलती होने पर अपनी रणनीति बदल सकते हैं

-

और कुछ मामलों में इंसानों की सलाह को नजरअंदाज भी कर सकते हैं

यही वह बिंदु है जहां चिंता शुरू होती है। क्योंकि जब कोई मशीन अपने फैसले खुद लेने लगे, तो सवाल उठता है कि उस फैसले की जिम्मेदारी किसकी होगी?

इंटरनेशनल रिपोर्ट में क्यों जताई गई चिंता

हाल ही में सामने आई इंटरनेशनल AI सेफ्टी रिपोर्ट के मुताबिक, 2026 तक AI एजेंट्स से जुड़े तीन बड़े जोखिम उभर सकते हैं। रिपोर्ट कहती है कि जिस रफ्तार से AI सिस्टम स्मार्ट होते जा रहे हैं, उसी रफ्तार से उनका गलत इस्तेमाल भी संभव है।

रिपोर्ट में साफ लिखा गया है कि:

-

AI एजेंट गलत या अधूरी जानकारी के आधार पर फैसले ले सकते हैं

-

वे ऐसे निर्णय भी ले सकते हैं, जिनका असर समाज, नौकरी और सुरक्षा पर पड़े

-

और अगर इन पर नियंत्रण नहीं रखा गया, तो नुकसान का दायरा बहुत बड़ा हो सकता है

विशेषज्ञ मानते हैं कि यह खतरा किसी एक देश तक सीमित नहीं है, बल्कि यह एक वैश्विक चुनौती बन चुकी है।

नौकरी, सुरक्षा और समाज पर असर

AI एजेंट्स के खुद फैसले लेने की क्षमता का सबसे पहला असर नौकरियों पर पड़ सकता है। कई सेक्टर्स में पहले ही ऑटोमेशन बढ़ चुका है, लेकिन अब AI एजेंट यह भी तय करने लगे हैं कि कौन सा काम इंसान करेगा और कौन सा मशीन।

इसके अलावा, डिफेंस और साइबर सिक्योरिटी के क्षेत्र में AI एजेंट्स का इस्तेमाल तेजी से बढ़ रहा है। अगर ऐसे सिस्टम गलत निर्णय लेते हैं या हैक हो जाते हैं, तो इसके परिणाम बेहद गंभीर हो सकते हैं।

सामाजिक स्तर पर भी चिंता है कि:

-

AI इंसानों की सोच को प्रभावित कर सकता है

-

गलत जानकारी को सही समझकर फैसले ले सकता है

-

और धीरे-धीरे इंसानों की निर्णय लेने की क्षमता कमजोर हो सकती है

क्या AI एजेंट इंसानों से ज्यादा स्मार्ट हो रहे हैं?

विशेषज्ञों का कहना है कि AI एजेंट “स्मार्ट” तो हो रहे हैं, लेकिन उनकी समझ अभी भी डेटा पर निर्भर है। वे वही जानते हैं जो उन्हें सिखाया गया है या जो डेटा उन्हें मिला है। समस्या तब आती है जब डेटा अधूरा, पक्षपाती या गलत हो।

कुछ मामलों में देखा गया है कि AI एजेंट्स ने ऐसे फैसले लिए, जिनमें नैतिकता या सामाजिक संवेदनशीलता की कमी थी। यही कारण है कि AI को पूरी तरह स्वतंत्र छोड़ देना फिलहाल सुरक्षित नहीं माना जा रहा।

AI ओलंपियाड और तकनीकी प्रतिस्पर्धा

दिलचस्प बात यह है कि AI सिस्टम इंटरनेशनल AI ओलंपियाड जैसी प्रतियोगिताओं में लगातार बेहतर प्रदर्शन कर रहे हैं। इससे यह साफ है कि तकनीकी स्तर पर AI तेजी से आगे बढ़ रहा है।

लेकिन रिपोर्ट यह भी चेतावनी देती है कि:

-

प्रतियोगिताओं में जीतना और

-

असल दुनिया में सुरक्षित तरीके से काम करना

दो अलग-अलग चीजें हैं। असल दुनिया में AI को इंसानों के साथ मिलकर काम करना होता है, जहां भावनाएं, नैतिकता और सामाजिक जिम्मेदारी भी अहम होती हैं।

क्या समाधान है?

विशेषज्ञ मानते हैं कि AI एजेंट्स को पूरी तरह रोकना संभव नहीं है, लेकिन उन्हें नियंत्रित और सुरक्षित ढंग से विकसित करना जरूरी है। इसके लिए कुछ अहम कदम सुझाए गए हैं:

-

AI सिस्टम में ट्रांसपेरेंसी बढ़ाई जाए

-

हर बड़े फैसले में मानवीय निगरानी अनिवार्य हो

-

AI से जुड़े कानून और नियम समय के साथ अपडेट किए जाएं

-

और डेवलपर्स को नैतिक जिम्मेदारी सिखाई जाए

कुछ देशों ने इस दिशा में काम शुरू भी कर दिया है, लेकिन यह एक लंबी प्रक्रिया मानी जा रही है।

भारत के लिए क्या मायने रखता है यह बदलाव

भारत जैसे देश के लिए AI एजेंट्स का विकास अवसर और चुनौती—दोनों है। एक तरफ इससे हेल्थकेयर, एजुकेशन और गवर्नेंस में सुधार हो सकता है, वहीं दूसरी तरफ गलत इस्तेमाल से बेरोजगारी और सामाजिक असंतुलन भी बढ़ सकता है।

भारतीय विशेषज्ञों का मानना है कि भारत को:

-

AI रिसर्च में निवेश बढ़ाना चाहिए

-

अपने डेटा और सिस्टम की सुरक्षा मजबूत करनी चाहिए

-

और युवाओं को AI के सही इस्तेमाल के लिए प्रशिक्षित करना चाहिए

2030 तक AI एजेंट्स और भी ज्यादा सक्षम हो सकते हैं। वे न सिर्फ निर्णय लेंगे, बल्कि उन फैसलों के परिणामों का आकलन भी करेंगे। ऐसे में सवाल यह नहीं है कि AI आगे बढ़ेगा या नहीं, बल्कि यह है कि हम इंसान कितनी समझदारी से उसे दिशा दे पाएंगे।

AI एक ताकत है, लेकिन बिना नियंत्रण के यही ताकत खतरा भी बन सकती है। इसलिए आने वाले सालों में AI एजेंट्स पर बहस और भी तेज होने वाली है।